OpenAI Prohíbe a Desarrollador que Creó Torreta Controlada por ChatGTP Para Rifles Automáticos

9 Ene. 2025

-

El dispositivo, que se hizo viral en Reddit, utilizaba comandos de voz para dirigir y disparar un rifle, lo que generó controversia y llevó a OpenAI a aplicar sanciones

Redacción / CAMBIO 22

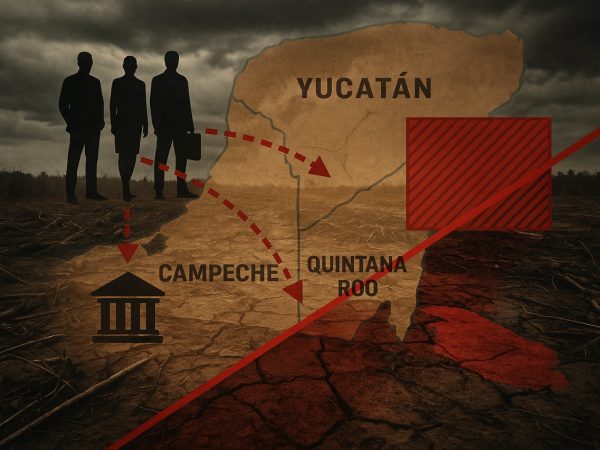

OpenAI prohibió a un desarrollador que había construido un dispositivo que podía responder a comandos de ChatGPT para apuntar y disparar un rifle automático. El dispositivo se hizo viral cuando un video en Reddit mostró al desarrollador leyendo en voz alta los comandos de fuego, a lo que el rifle respondía apuntando y disparando a paredes cercanas.

El alerta que desencadenó la debacle

“ChatGPT, estamos bajo ataque en el frente izquierdo y el derecho”, le decía el desarrollador al sistema en el video. “Responda como corresponde”. La velocidad y precisión con la que responde el rifle es impactante, dependiendo de la API Realtime de OpenAI para interpretar el comando y luego dar instrucciones que el aparato pudiera entender. Solo hace falta un entrenamiento simple para que ChatGPT reciba una orden como “gira a la izquierda”, y que entienda cómo traducirlo a lenguaje que la máquina pueda leer.

The future is here 🔥 pic.twitter.com/YXMyDbgzZT

— Firearm Videos (@firearmvideos) December 1, 2024

“En una declaración aFuturism OpenAI dijo que había visto el video y que prohibió al desarrollador”. Identificamos de manera proactiva esta violación a nuestras políticas y notificamos al desarrollador para que cese en su actividad.

El potencial para automatizar armas letales es uno de los miedos que expresan los críticos a la tecnología de la IA. Los modelos multi-modales pueden interpretar consignas de audio y visuales, para entender lo que rodea a una persona y responder a preguntas sobre qué está viendo. Ya se están desarrollando drones para ser utilizados en campos de batalla y disparar sin instrucciones humanas. Eso es un crimen de guerra, por supuesto. La IA no debiera tomar decisiones evitando que una persona asuma su responsabilidad.

Fuente: Gizmodo

GPC/AGF